【2025年衛生福利部《臨床AI取證驗證中心聯合啟動大會暨國際研討會》系列文章 3】

從美國 FDA 看見臺灣臨床 AI 發展的契機:以實證與制度為本的轉型之路|石瑜教授

在當前全球 AI 醫療快速發展的浪潮中,本次很榮幸邀請行政院生技產業策略諮議委員會議(BTC)的石瑜教授,以其在美國食品藥物管理局(FDA)外部委員會的親身參與經驗,帶領聽眾深入理解 AI 醫療審查的制度設計、評估邏輯與使用者觀點,並從國際角度回顧臺灣臨床 AI 驗證中心的實踐與潛力,為下一階段政策思維注入高度實證與制度導向的啟發。

- 臺灣臨床 AI 驗證制度已站上國際舞台

首先,石瑜教授稱讚臺灣在推動臨床 AI 驗證制度上已具備制度先行、實證導向的優勢。尤其三大 AI 中心的成立,不僅整合跨院資源、導入聯邦學習、標準化資料交換格式(FHIR),更逐步建立一套科學、可複製的取證驗證流程。這樣的制度性工程,不僅強化臺灣在國際 AI 醫療領域的信任度,也提供新興國家參考的治理模式。

- 美國 FDA 模型:公開、嚴謹與可問責的審查流程

接著,石瑜教授以自身參與 FDA 新藥審查委員會的實務經驗為例,具體說明美國如何以高度透明的程序確保審查正當性:包括開放式公聽會、雙向書面回應、公開錄音投票等,確保每一項醫療產品的審查過程皆可追溯。這種制度設計不僅強化社會信任,也讓創新技術得以在「不犧牲安全」的前提下前進。

圖一、石瑜教授線上直播場與陳適安名譽院長

- AI 醫療器材草案:六大審查新基準

針對 FDA 最新的 AI-enabled device 指引草案(2025),整理以下六項重點原則,作為臺灣未來制度優化的參考:

- 全產品生命週期監管(Total Product Lifecycle Focus)

美國 FDA 建議針對 AI 醫療器材採取「全產品生命週期」(TPLC)監管模式,要求製造商自產品設計初期起,即全面考量其安全性、有效性、透明度、臨床效用與偏誤風險,並持續至上市後的監測與更新階段。

- 完整的送審文件要求(Comprehensive Submission Requirements)

AI 醫療器材進行上市申請(如 510(k)、De Novo、PMA 等)時,必須提交詳盡的技術文件,內容包括:產品描述、預期用途、資料管理、模型開發流程、驗證方式、效能指標(含信賴區間),以及上市後的效能監控機制。

- 資訊透明與偏誤控管(Transparency and Bias Mitigation)

申請者須證明其 AI 醫療器材如何有效降低模型偏誤(例如針對種族、性別、年齡等群體),並強化資訊透明度。相關作法應包括:清楚的標示標籤、使用者介面說明,以及模型資訊卡(model cards),以協助使用者理解其功能與限制。

- 預定變更控制計畫(Predetermined Change Control Plans, PCCP)

鼓勵製造商預先規劃 AI 模型可能進行的修改與更新,並於送審時提出「預定變更控制計畫(PCCP)」。一旦獲得核准,後續符合該計畫條件的模型變更,即可在不需重新送審的情況下獲得授權,兼顧創新彈性與審查效率。

- 風險管理(Risk Management)

製造商需建置完整的風險管理檔案,涵蓋從產品開發至退場的各階段,包含對潛在風險的識別、評估與緩解措施。風險範疇包括:使用者誤解、資料漂移(data drift)、資料隱私與資訊安全等議題。

- 驗證與效能報告(Validation and Performance Reporting)

驗證研究應包含多元資料來源、族群多樣性與子族群分析。效能指標(如 AUROC、靈敏度、特異性、陽性/陰性預測值)應提供信賴區間及各子族群結果,以證明該產品對目標族群具備全面且穩定的安全性與有效性,並符合科學設計原則。強調除了開發端的內部驗證,亦需第三方外部驗證證明臨床適用性

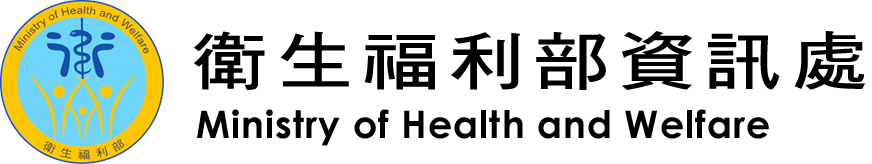

- PPV 與 NPV:真正符合臨床價值的指標思維

針對 AI 模型評估指標,石瑜強調,AUC、Sensitivity 與 Specificity 雖常見,卻不一定反映病患關心的問題;PPV與NPV才是病人與家屬最關心的指標,遠比敏感度或特異度更具臨床決策意義:

PPV(陽性預測值) = 我被判為陽性,實際有病的機率是多少?

NPV(陰性預測值) = 我被判為陰性,實際無病的機率是多少?

以cfDNA 用於唐氏症篩檢為例,傳統方法(STD Screening)雖有 96% AUC,但陽性預測值(PPV)僅 3.4%,造成大量假陽性;而 cfDNA 方法的 PPV 則高達 81%,大幅減少誤診與資源浪費,並降低數百位孕婦的心理壓力,展現 AI 與精準預測的真正價值。因此,建議臺灣應在審查與臨床採購層面納入「PPV/NPV 對病患決策的實質貢獻」作為評估標準,提升 AI 工具在臨床的實用性與信任度。

圖二、超越 AUC 的臨床價值思維,cfDNA用於唐氏症篩檢的效益比較

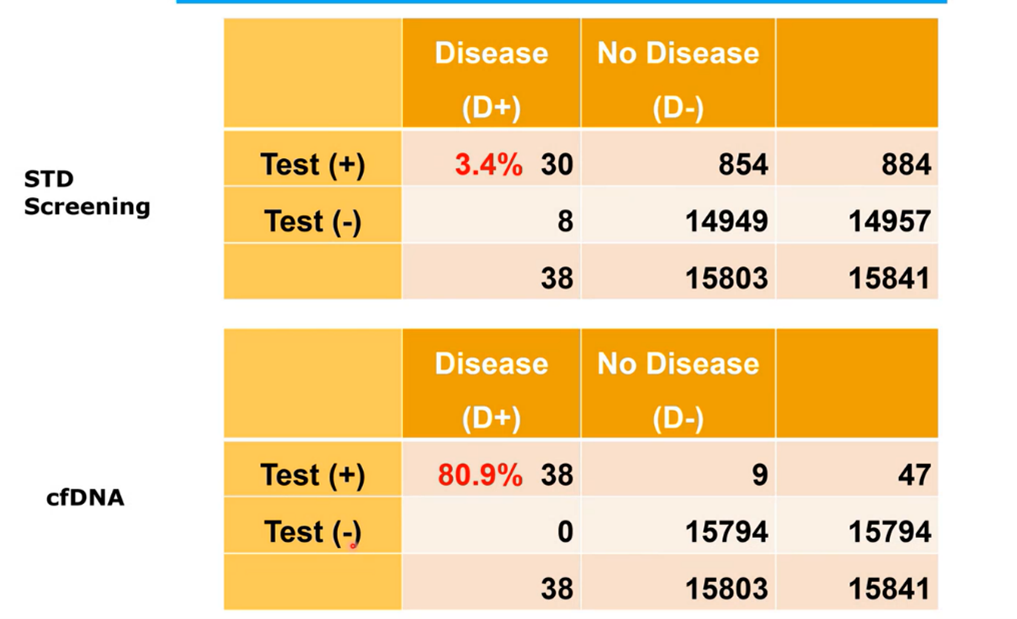

- 推動Pragmatic Platform Trial:臺灣下一步制度創新

石瑜教授特別呼籲臺灣啟動「國家級 Pragmatic Platform Trial」機制,建構開放式、可多家 AI 工具同時驗證的臨床平台,讓臨床醫師與醫院管理者可於實際場域中比較不同模型表現,以「動態優勝淘汰制」選出最佳解決方案。此類設計可兼顧審查合格與臨床落地,破解當前「AI 工具選擇困難症」,並為健保支付決策提供具體依據,實現商業與照護的良性結合。

圖三、Pragmatic Platform Trial制度 (取自石瑜教授線上演講投影片)

- 從龐貝手卷到Radiomics將持續引領醫療 AI 創新

美國核准的 AI Device 多數來自影像領域(Radiology),應用情境不拘泥於「取代醫師」(Replace),而可包含Reduce 減少醫療人員工作負擔(如病理切片分類)、Remind發出早期警示(如 ICU 監測)、Reassure提供第二意見或強化診斷信心。以龐貝城碳化手稿成功重建的 AI 案例為例,影像學在 AI 發展中潛力無窮。影像作為 AI 的訓練輸入與臨床應用場景,具備高度可行性與推廣價值。

從 AI 效能衰退到模型修復:UCSF Jean Feng 教授談臨床 AI 的生命週期管理與外部驗證策略|Jean Feng教授

美國加州大學舊金山分校(UCSF)Jean Feng 教授以《External Validation of Clinical AI models: Addressing Performance Decay & Domain Shift》為題發表專題演講。她從統計方法與臨床應用的交會點出發,深入剖析 AI 模型在實務部署中的效能衰退現象、外部驗證策略與修復技術,並對臺灣正在發展中的 AI 外部驗證中心制度給予高度肯定與建議。

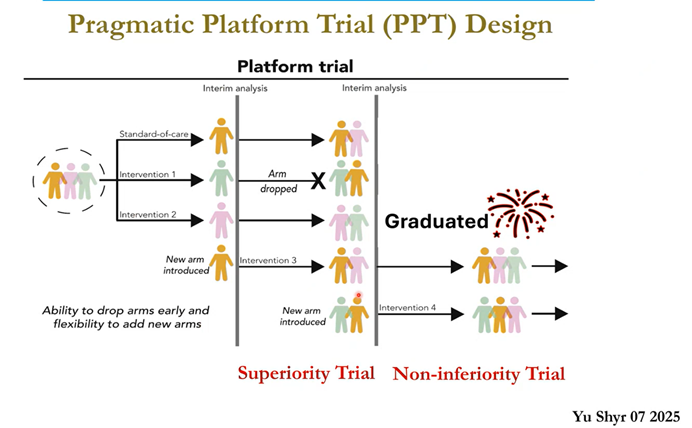

- AI 模型效能為何會「衰退」?模型不是永遠準:外部驗證與時間性效能衰退

圖四、外部驗證效能下降與子群退化現象

Feng教授指出,多數AI模型即使在開發階段表現優異,但在跨機構、跨時間部署後,常出現效能下降現象(Performance Decay),甚至針對特定族群產生「子群退化(Subgroup Decay)」。她以美國 Epic 敗血症模型為例,雖然原於三家醫院開發,卻在密西根州第三方研究中顯示真實效能遠低於預期,特別是在老年人等特定族群。

此外,COVID-19 疫情亦暴露 AI 模型的「時間敏感性」:許多模型在疫情前表現穩定,但在疫情爆發後因資料分布劇變而失效,反映「資料漂移(Data Drift)」與「預後改變(Outcome Shift)」的風險。

- 跨機構模型部署的挑戰與修復策略

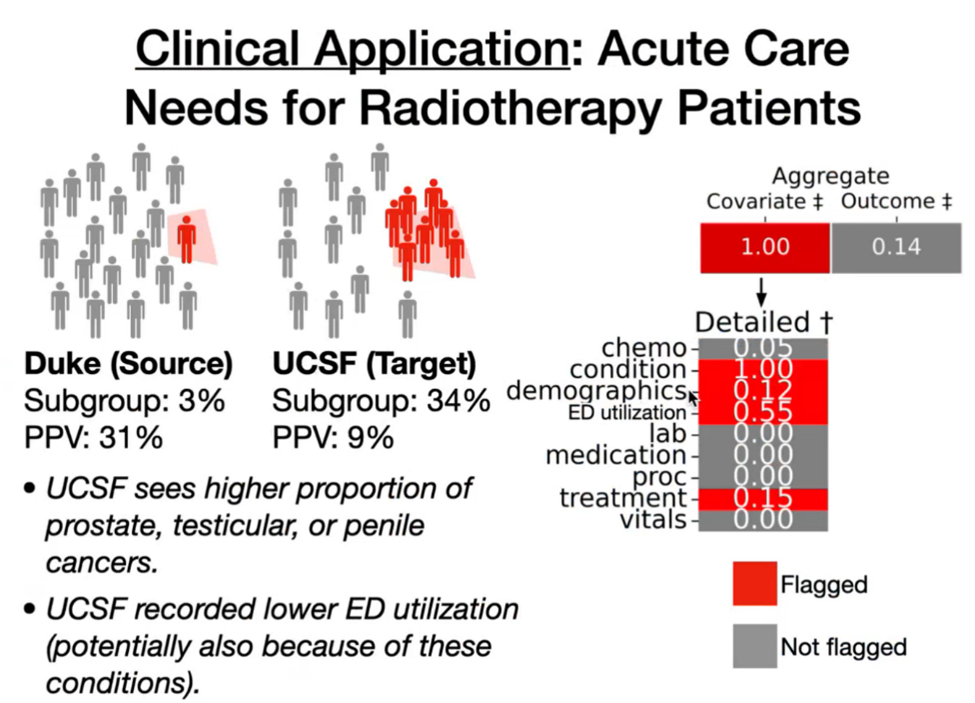

案例一:Duke → UCSF 移轉失敗的放射治療模型

Feng 教授分享,Duke 開發一款放療後急診預測模型,在院內 RCT 中將急診率從 22% 降至 12%;但移轉至 UCSF 後,PPV 驟降至 9%。分析後發現,此屬於「Covariate Shift」:原模型未充分訓練在 UCSF 常見的前列腺癌族群。最終透過針對特定子群啟用 UCSF 在地訓練模型,使 PPV 回升至 19%。

圖五、Duke → UCSF 移轉失敗的放射治療模型 投影片說明

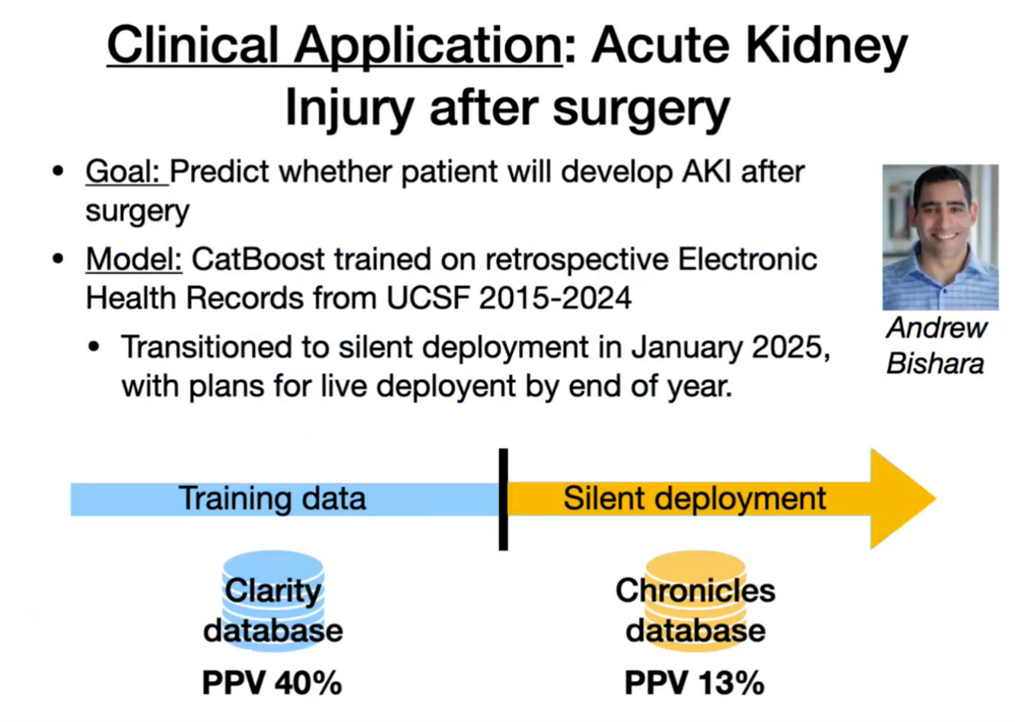

案例二:部署錯誤導致急性腎損傷模型失效

另一案例中,一款急性腎損傷預測模型在靜默部署前 PPV 為 40%,實際部署後卻降至 13%。問題源自資料擷取程序錯誤,導致實測資料缺少重要變項(如實驗室數據)。透過修正抽取代碼後,效能隨即回升。兩個案例皆顯示,外部效能下降並非必然代表模型失效,而需透過統計診斷工具釐清根本原因,再選擇對應的修復策略。

圖六、部署錯誤導致急性腎損傷模型失效案例 投影片說明

- 從外部驗證邁向 AI 臨床品質保證生命週期

Feng 教授強調:「AI 模型不是一次取證、終身有效的產品,而是需要持續品質監測的『生命體』。」

她提出「臨床 AI 品質保證生命週期」的三大要素:

- 外部效能監測與預警機制

- 子群敏感性分析與因果診斷工具

- 可執行的模型修復策略(如替代模型、閾值調整)

她指出,臺灣若能以 AI 外部驗證中心為核心,發展一整套可操作的Quality Assessment (QA)流程,將可解決臨床現場「模型何時失效?該如何修補?」的核心難題。

- 臺灣經驗:全球首創 AI 外部驗證中心值得關注

Feng 教授肯定臺灣在 AI 驗證制度上的前瞻性發展,特別指出:「臺灣能以國家級規模建立聯邦式 AI 外部驗證中心,從技術到制度層面,皆為全球首創。」她認為,臺灣現有的跨院聯盟與 FHIR 資料基礎,有機會發展出可支持模型監測、效能診斷與在地化修復的 AI 品質保證(AI QA)架構,並成為全球典範。Jean Feng教授的演講不僅揭示了 AI 模型部署的隱性風險,更提供臺灣具體可行的政策藍圖。她以科學與制度融合的視角,強調:「外部驗證只是起點,唯有建立可解釋、可修復、可持續的 AI 品質生命週期,才能真正讓 AI 成為臨床可靠的夥伴。」

圖七、Jean Feng教授線上直播與李建璋處長